Чоловік потрапив до лікарні з важкими психіатричними симптомами після того, як почав дотримуватися дієтичної поради, отриманої від чат-бота штучного інтелекту.

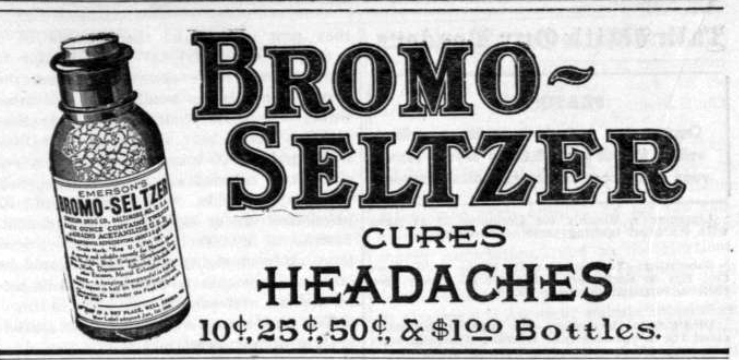

Намагаючись зменшити споживання солі, пацієнт запитав у ChatGPT, чим можна замінити хлорид натрію. Серед запропонованих варіантів виявився бромід натрію — сполука, яка використовується переважно для очищення гарячих ванн, а не як харчова приправа. Не отримавши належного попередження, чоловік замовив цю речовину онлайн і вживав її протягом трьох місяців.

Зрештою він потрапив до відділення невідкладної допомоги з параноїдальною маячнею, галюцинаціями та спробою втечі, що призвело до примусової госпіталізації у психіатричний заклад. Лікарі виявили у нього надзвичайно високий рівень брому в крові — 1700 мг/л при нормі менше 10 мг/л, діагностувавши бромізм, рідкісний нині токсикологічний синдром.

Як пояснюють автори клінічного звіту, «малоймовірно, що медичний експерт згадав би про бромід натрію, коли б зіткнувся з пацієнтом, який шукає життєздатну заміну хлориду натрію». Вони підкреслили, що системи ШІ можуть генерувати наукові неточності та сприяти поширенню дезінформації, особливо у сфері медицини.

Після тритижневого лікування антипсихотичними препаратами та підтримувальної терапії чоловік був виписаний без серйозних ускладнень. Випадок, опублікований у журналі Annals of Internal Medicine: Clinical Cases, став нагадуванням, що технології ШІ не можуть замінити кваліфіковану медичну консультацію.

#Чатбот #порадив #токсичну #сіль #пацієнт #лікарні

Source link