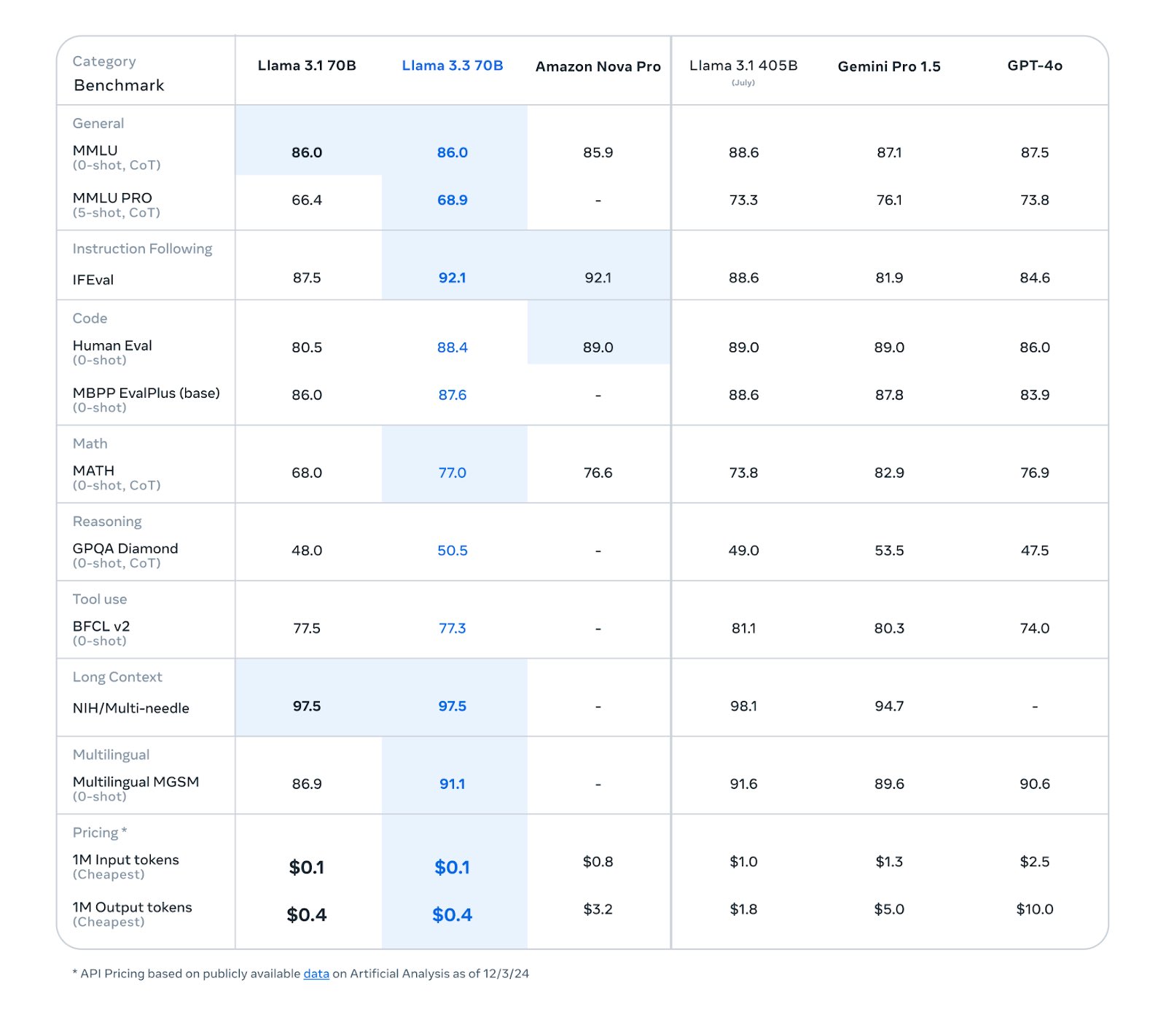

Meta анонсувала випуск Llama 3.3 70B — генеративної моделі штучного інтелекту, яка забезпечує продуктивність, порівнянну з Llama 3.1 405B, але використовує лише 70 мільярдів параметрів. Ця модель перевершує конкурентів, таких як Google Gemini 1.5 Pro і OpenAI GPT-4o, за результатами тестів MMLU, демонструючи кращі навички в математиці та слідуванні інструкціям.

За словами віцепрезидента Meta Ахмада Аль-Дахле, досягнення стало можливим завдяки сучасним методам постнавчання, що дозволяють оптимізувати продуктивність при значному зниженні витрат. Модель уже завантажена понад 650 мільйонів разів, а АІ-помічник Meta AI, який базується на Llama, обслуговує 600 мільйонів активних користувачів щомісяця — удвічі більше, ніж у ChatGPT.

Meta зробила Llama 3.3 доступною для завантаження через платформи Hugging Face та офіційний сайт Llama. Проте для великих проєктів, аудиторія яких перевищує 700 мільйонів користувачів на місяць, потрібна спеціальна ліцензія.

Компанія інвестує значні ресурси в розвиток інфраструктури для підготовки наступного покоління Llama. Марк Цукерберг заявив, що Meta закупила понад 100 тисяч графічних процесорів Nvidia і планує використати в 10 разів більше обчислювальних потужностей для тренування Llama 4. У другому кварталі 2024 року капітальні витрати Meta зросли на 33%, досягнувши $8,5 мільярда.

Попри успіх, Meta стикається з проблемами, пов’язаними з міжнародними нормами. Китайські дослідники вже застосували Llama для створення військових чат-ботів, що викликало занепокоєння Пентагону. У відповідь Meta надала доступ до своїх моделей американським оборонним підрядникам, підтримуючи їхні ініціативи у сфері ШІ.

#Llama #забезпечує #продуктивність #топових #моделей #за #менших #витрат

Source link