Після серії резонансних справ з діпфейками, в ході яких Midjourney став платним, як ніколи актуалізувалось питання: як відрізнити фотографії, створені штучним інтелектом, від реальних?

Справжнє фото, чи згенероване штучним інтелектом: розпізнаємо підробку

За останні декілька років розвиток штучного інтелекту перевершив будь-які сподівання. Спочатку для користувачів відкрились автоматичні відповіді в чат-ботах, далі машина почала заміняти операторів колл-центрів.

Тепер черга дійшла до світлин, які штучний розум навчився генерувати з неймовірною реалістичністю. Фотографії, створені AI, майже не відрізняються від справжніх. Проте існує декілька моментів, за допомогою яких можна побачити різницю. Далі поговоримо про це більш детально та покажемо, як швидко розпізнати фото, згенеровані штучним інтелектом.

- Штучний «фотограф»: як це працює?

- Злі жарти нейромережі

- Уявні землетруси та природні катаклізми

- Максимально збільшити зображення для ретельного вивчення деталей

- Знайдіть першоджерело

- Особлива увага на пропорційність об’єктів

- Запам’ятайте та помічайте типові помилки нейромережі

- Довіряйте власній інтуїції

- Зверніть увагу на тло

Штучний «фотограф»: як це працює?

Ми завжди щось малюємо в своїй уяві. Тепер ці картинки досить просто матеріалізувати. Для цього знадобиться доступ до всесвітньої павутини та інструменти ШІ. Для найбільш популярних нейромереж Midjourney, DALL-E або DeepAI створити реалістичне зображення або фантастичну картинку — просте завдання.

Розширюйте знання: Альтернатива Midjourney: 3 безкоштовні нейромережі, що малюють за запитом

ШІ може самостійно продукувати абсолютно унікальний контент або трансформувати уже існуючий. Нейромережа здатна змінювати кольори та форму зображених предметів, переставляти об’єкти, прибирати зайві або додавати нові. Крім цього AI може виконати наявну картинку в зовсім іншому стилі чи жанрі. І це ще не всі можливості.

В більшості випадків користування «послугами» нейромережі є безкоштовним, або це вартує відносно недорого. Завдяки такій доступності інтернет-простір заполонили сотні різноманітних зображень. Людям багатьох професій, таких як маркетологи, копірайтери, дизайнери, ШІ став у нагоді. Він полегшив роботу та звільнив багато часу для чогось іншого. Разом з тим, нейромережу почали використовувати з поганими намірами. Наприклад, для пропаганди та дезінформації.

Злі жарти нейромережі

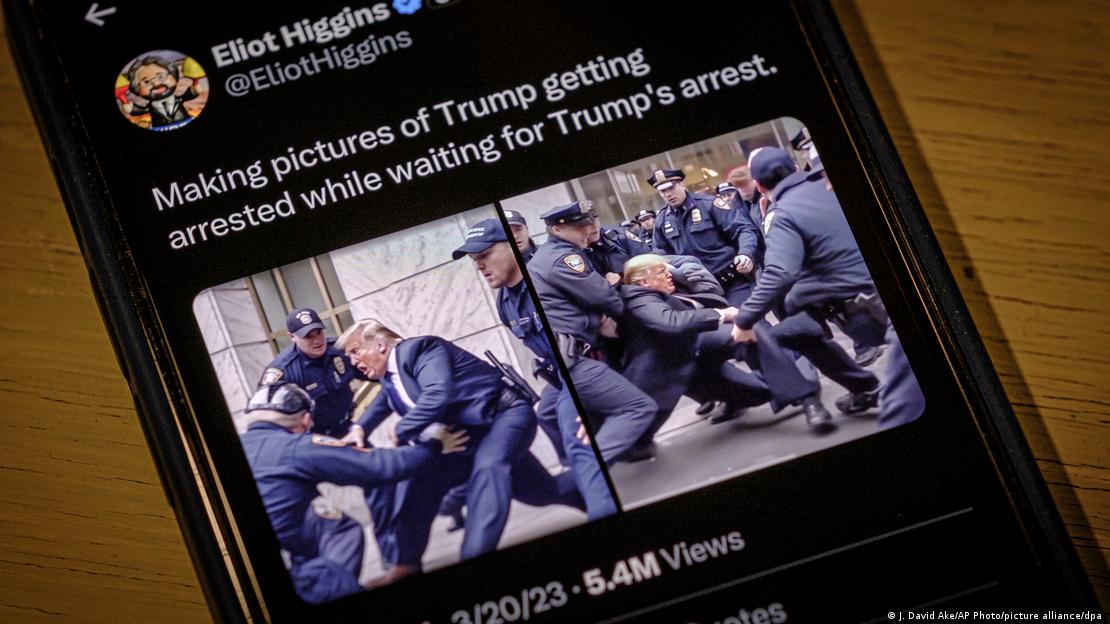

Скріншот згенерованої за допомогою ШІ фотографії Дональда Трампа Фото: J. David Ake/AP Photo/picture alliance/dpa

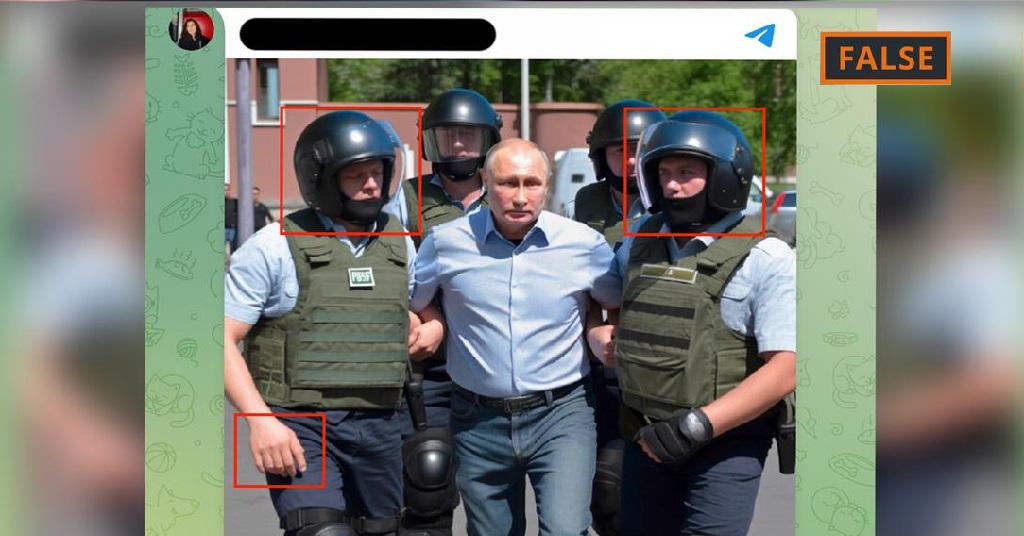

В останні місяці інтернет особливо рясніє знімками, автором яких є штучний інтелект. Найбільшого галасу наробили декілька фотографій. На першій зображений начебто володимир путін, який став на коліно перед головою Китаю Сі Цзіньпіном та в такому положенні цілує йому руку. На іншій бачимо нібито Дональда Трампа в тісному кільці поліцейських під час його начебто арешту. До речі, існує фото з такою ж тематикою за участі російського президента.

ШІ не обійшов увагою навіть Папу Римського. В мережі «гуляє» зображення, на якому Понтифік начебто одягнений у модний пуховик білого кольору. Над Ілоном Маском нейромережа пожартувала, зобразивши його поруч з найзаклятішою конкуренткою — генеральною директоркою General Motors. На світлині нібито Ілон Маск прогулюється містом з Мері Барру, мило тримаючись за руки.

Цікаве по темі: Штучний інтелект Midjourney може замінити художників — оновлення нейромережі

Скріншот згенерованої за допомогою ШІ фотографії Ілона та Мері

Усі ці зображення виглядають дуже реалістичними, якщо мати на увазі саме технічне виконання. При цьому подій, які вони демонструють, ніколи не було в реальності. Тому напрошується приголомшливий висновок — штучний інтелект починає стирати межу між реальністю та вигадкою. І чим далі, тим більше він вдосконалюється.

Уявні землетруси та природні катаклізми

Коли справа стосується світлин якихось визначних подій, таких як автоперегони, космічні польоти або гучні арешти відомих людей, перевірити справжність досить просто. Користувач має звернутися до авторитетних видань масової інформації або інших інтернет-ресурсів, вартих довіри, і пошукати там підтвердження події.

Проте, коли справа стосується не надто відомих особистостей, про яких не писатимуть всюди, поширювати дезінформацію стає значно простіше. Про це розповів експерт з нейронних мереж Генрі Ейдер в останньому інтерв’ю. За його словами, вигадані події можуть стосуватися не лише конкретних особистостей, але й природних явищ.

Наприклад, Ейдер знайомий з людиною, яка створила фотографію землетрусу, якого насправді ніколи не було. Мова йде про світлини нібито потужного землетрусу у Тихому океані в 2001 році. Розміщена на англомовному ресурсі Reddit світлина була створена за допомогою нейромережі.

Тут виникає закономірне питання: «А як відрізнити справжні фото від створених ШІ?» Наразі існують критерії, які показують різницю. Незважаючи на швидкий розвиток нейронних мереж, вони все ще припускаються багатьох помилок. Далі пропонуємо кілька порад, щоб не потрапити на гачок маніпуляції.

Максимально збільшити зображення для ретельного вивчення деталей

Більшість світлин, створених нейромережею, виглядають дуже реалістично. Проте при збільшенні масштабу можливо розгледіти дивні деталі. Для цього потрібно скачати фото в максимально високій якості. Наприклад, стають помітними нестикування ліній, невідповідність тіней, неспівпадіння кольорів, клони деталей і т.д.

Читайте актуальне: Як штучний інтелект змінює перебіг виборів у США у 2024 році

Знайдіть першоджерело

Перший спосіб перевірити чи правдива інформація перед вами — знайти її підтвердження на інших платформах. Це правило працює і з зображеннями також. Якщо маєте сумніви щодо реалістичності світлини, пошукайте її першоджерело. Пошук можна почати з прочитання коментарів. Часто там відбуваються жваві обговорення, в яких можна натрапити на першу публікацію фото.

Інший спосіб знайти джерело картинки — використати зворотній пошук. Для цього завантажте світлину в один із відповідних інструментів, наприклад, Google або TіnEye. Після аналізу зображення отримаєте додаткову інформацію щодо нього, а можливо і дані про його походження. Якщо авторитетні ресурси уже провели фактчекінг, пошуковик видасть його результати.

Особлива увага на пропорційність об’єктів

Найчастіше ШІ помиляється саме у зображені пропорцій тіла, присутніх на фото людей. Занадто маленькі руки з занадто довгими пальцями, або навпаки занадто великі руки — це ознаки створеного нейромережею зображення. Також часто на дезінформуючих знімках зустрічаються невідповідності розмірів голови та тулуба.

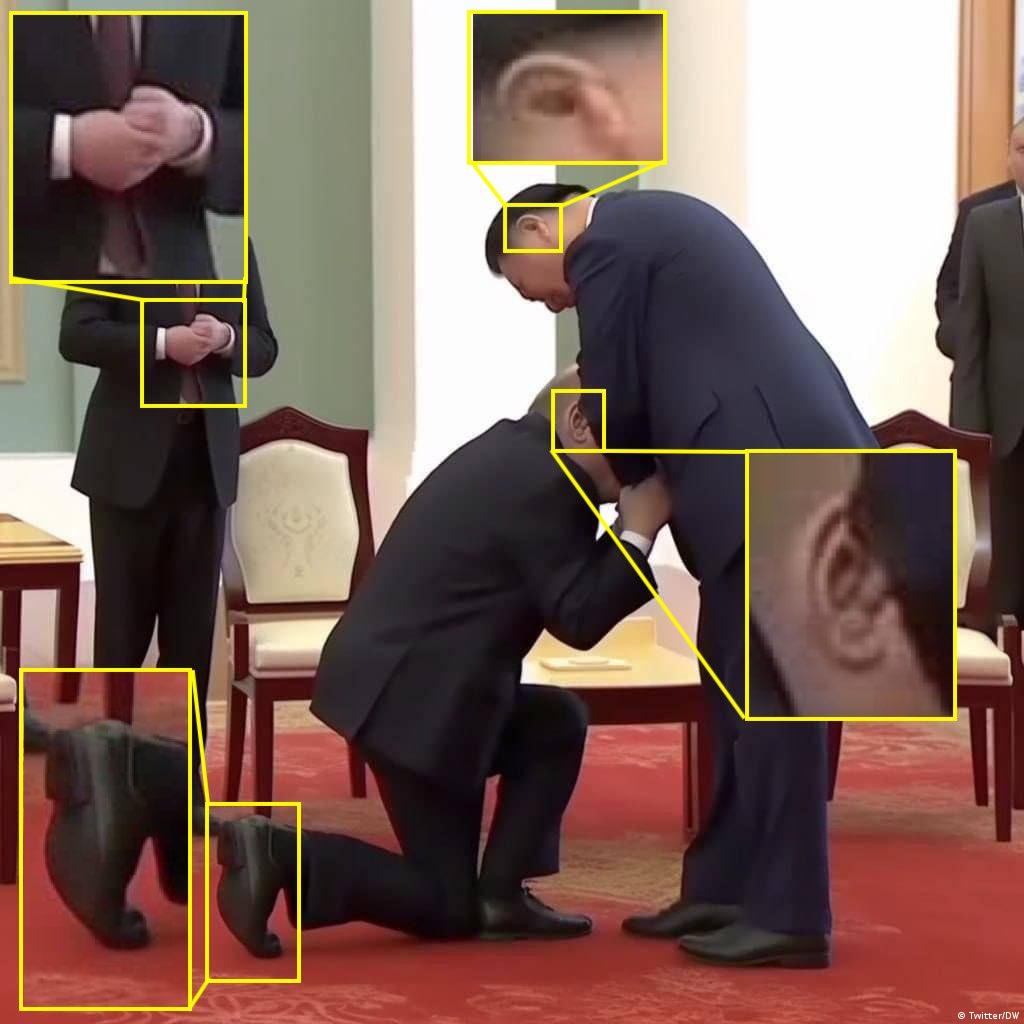

Наприклад, на згенерованій світлині путіна І Сі Цзіньпіна черевик, розташований позаду, занадто великий та широкий. Та ж нога видається ніби розтягнутою. А голова непропорційно велика по відношенню до тіла.

Скріншот згенерованої за допомогою ШІ фотографії путіна та Сі Фото: Twitter/DW

Цікаве по темі: Slack анонсував запуск месенджера на основі штучного інтелекту

Запам’ятайте та помічайте типові помилки нейромережі

Станом на сьогодні програми зі штучним інтелектом не навчились зображувати пропорційно правильне тіло людини. Особливо проблема у ШІ з руками. Дуже часто нейромережі домальовують шостий палець або, навпаки, прибирають п’ятий. Це яскраво ілюструють зображення російського диктатора, нібито під час арешту, де у одного з поліцейських (той, що ліворуч від президента) відсутній один палець. На згенерованій світлині Папи Римського у пуховику одна рука теж лише з чотирма пальцями.

Дуже часто у вигаданих персон виявляється занадто багато зубів, неприродньої форми вуха, ніс або очі. Щоб маскувати недоліки, AI нерідко надягає людям окуляри. Але вони сидять неприродньо і виглядають дивно. Також проблеми для реалістичності зображень ШІ додають відображення у вікнах чи інших глянцевих поверхнях.

Довіряйте власній інтуїції

Штучний інтелект прагне до досконалості. Іноді це грає йому не на руку, адже створені ним зображення виглядають надто ідеальними, а тому не природніми. Тому, радимо довіряти власному чуттю: чи можливо, щоб реальна фотографія була такою бездоганною? Коли мова йде про портретні світлини, недовіру може викликати занадто гладенька шкіра, без натяку на нерівність тону. Підозрілі, занадто ідеальні зуби та волосся.

Бездоганні люди на бездоганному тлі — явна ознака фальшивки. Такого результату не можливо досягти з ідеальними моделями та професійними фотографами, навіть після обробки. Але нейромережа створює зображення, які мають вподобати всі.

Зверніть увагу: Найбільший фотобанк подав до суду на ШІ за крадіжку зображень: подробиці

Зверніть увагу на тло

Щоб виявити світлину, створену ШІ, варто уважно придивитись до заднього фону. Часто об’єкти на тлі спотворюються: ліхтарі викривляються, дерева витягуються. Також AI «полюбляє» клонувати людей чи предмети. Тож на одному зображенні можна знайти чимало близнюків.

Попри все вищезгадане слід розуміти, що ШІ невпинно вчиться, а отже невдовзі перераховані помилки зійдуть нанівець. Вдосконалення технологій знизить в рази ефективність роботи детекторів, таких як Hugging Face. Подібні програми не можуть виявляти фальшивки. Їх максимум — давати підказки і на тому все.

Покладатися повністю на детектори не радять експерти, адже програми теж помиляються і в результаті справжні фотографії оголошуються дезінформацією, а фейки — реальними світлинами. Напрошується невтішний висновок — пора звикати до думки, що не можна довіряти жодному зображенню в мережі інтернет.

Популярні матеріали по темі:

У ЄС створили аналітичний центр для виявлення небезпек штучного інтелекту

У пошуку Google з’являться відео з TikTok та можливість спілкування з ШІ

Штучний інтелект навчився трансформувати відео: Runway випустив Gen-1

Prompt

#Справжнє #фото #чи #згенероване #штучним #інтелектом #розпізнаємо #підробку

Source link